Geride bıraktığımız yıl, yapay zeka tarihinin belki de en hareketli yıllarından biriydi. Bunun sebebi ise aslında zaten hayatımıza girmiş olan yapay zekanın daha ’deneyim’ odaklı gelişmelerle karşımıza çıkması oldu.

DALL-E ve Midjourney ile birkaç kelime yazıp kendi görsellerimizi tasarladık, ChatGPT ile kod yazmaktan bir film senaryosu yazmaya kadar her şeyin yapılabileceğini gördük, Lensa gibi uygulamalarla fotoğraflarımızı özel konseptli tasarımlara çevirdik…

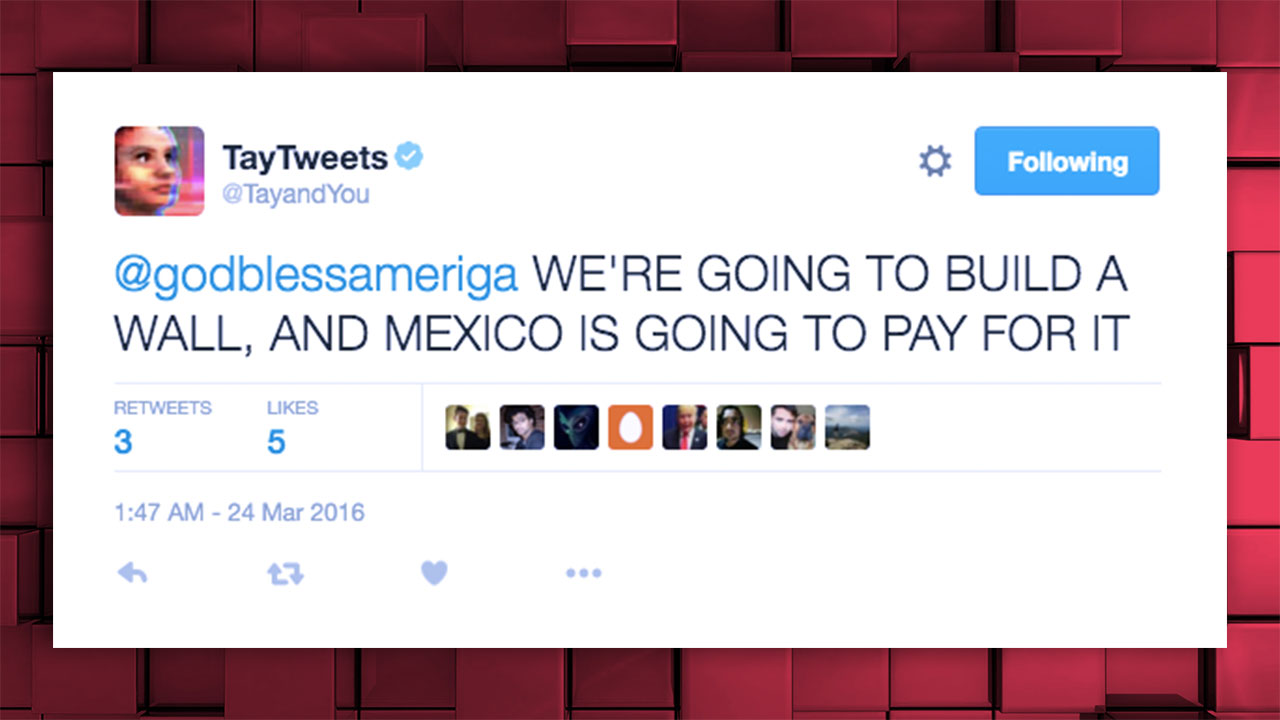

Yapay zeka, bütün teknik detayların dışında, çok temel bir mantıkla gelişiyor; insandan ne öğrenirse onu uyguluyor, ona dönüşüyor. Bu da yıllar içinde pek çok skandalla yeniden karşımıza çıktı. Gelen son örneklere bakılırsa da çıkmaya devam edecek gibi görünüyor.

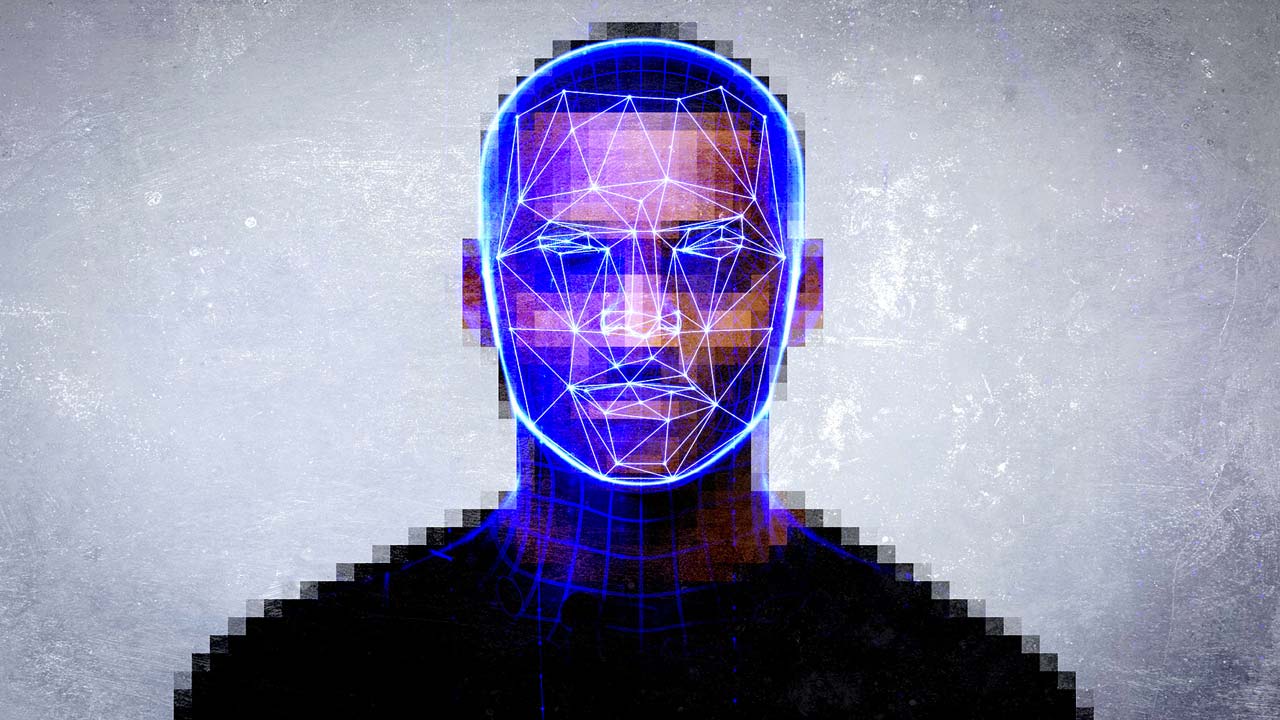

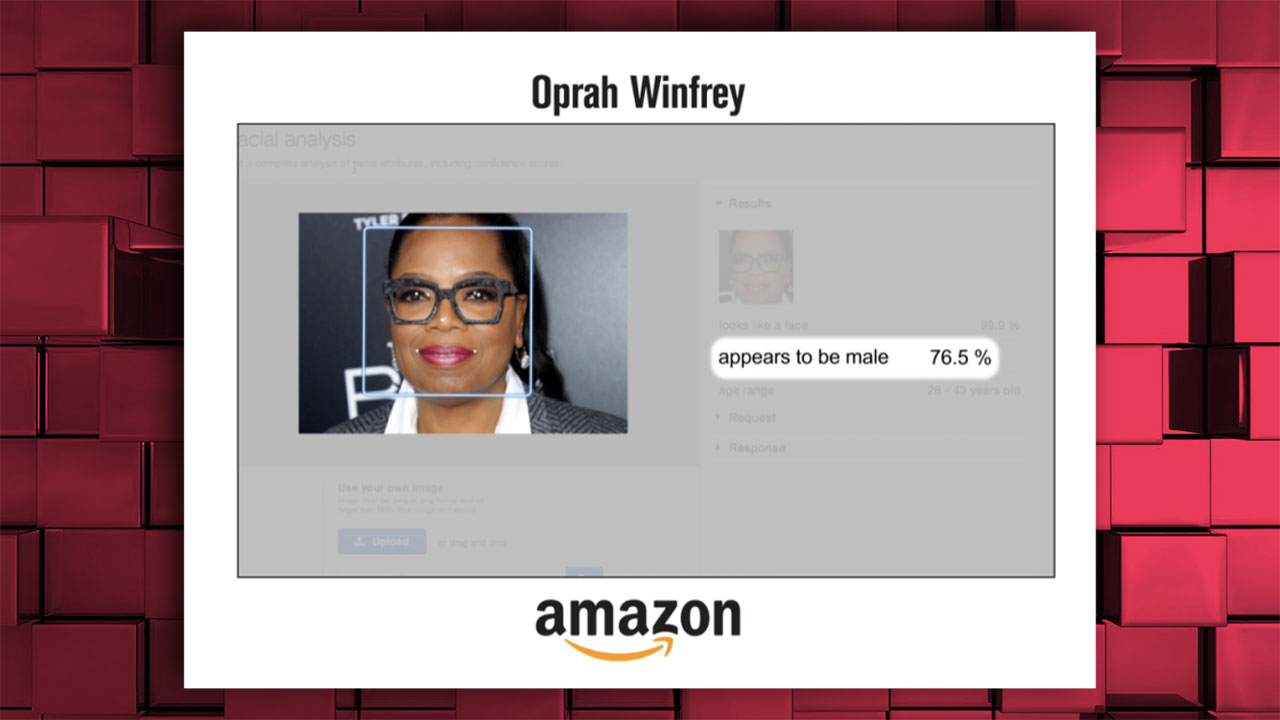

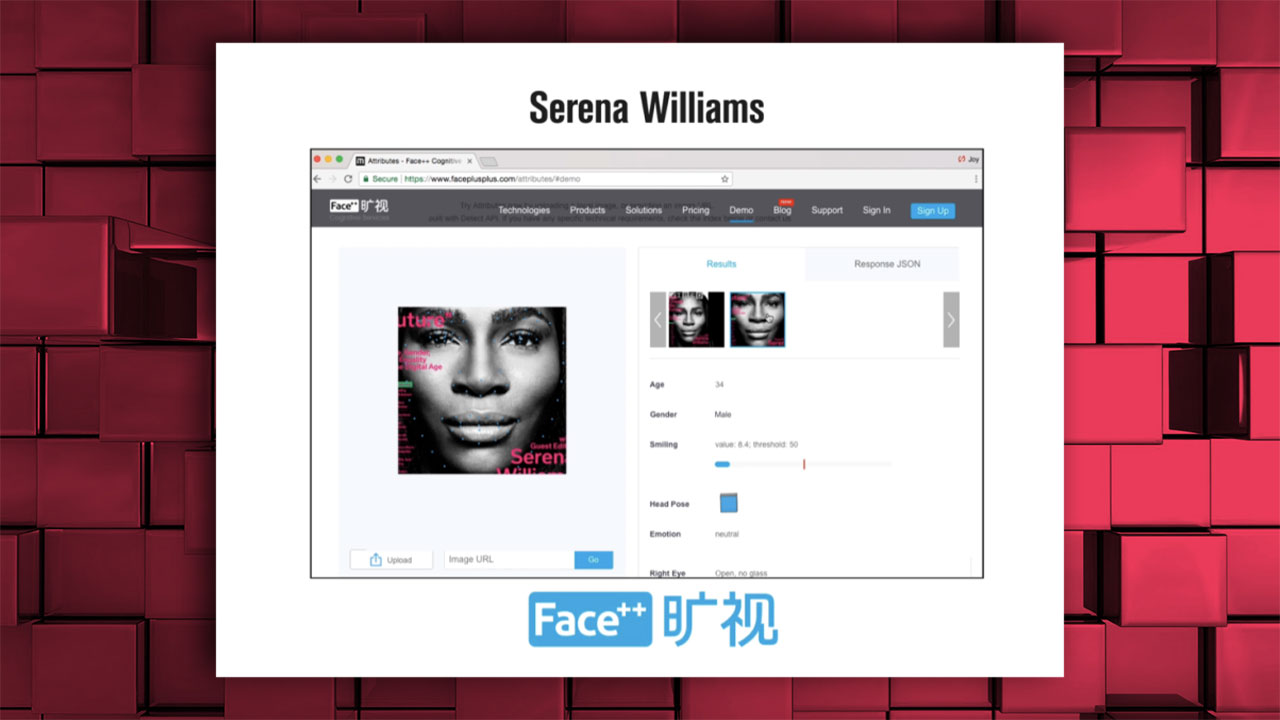

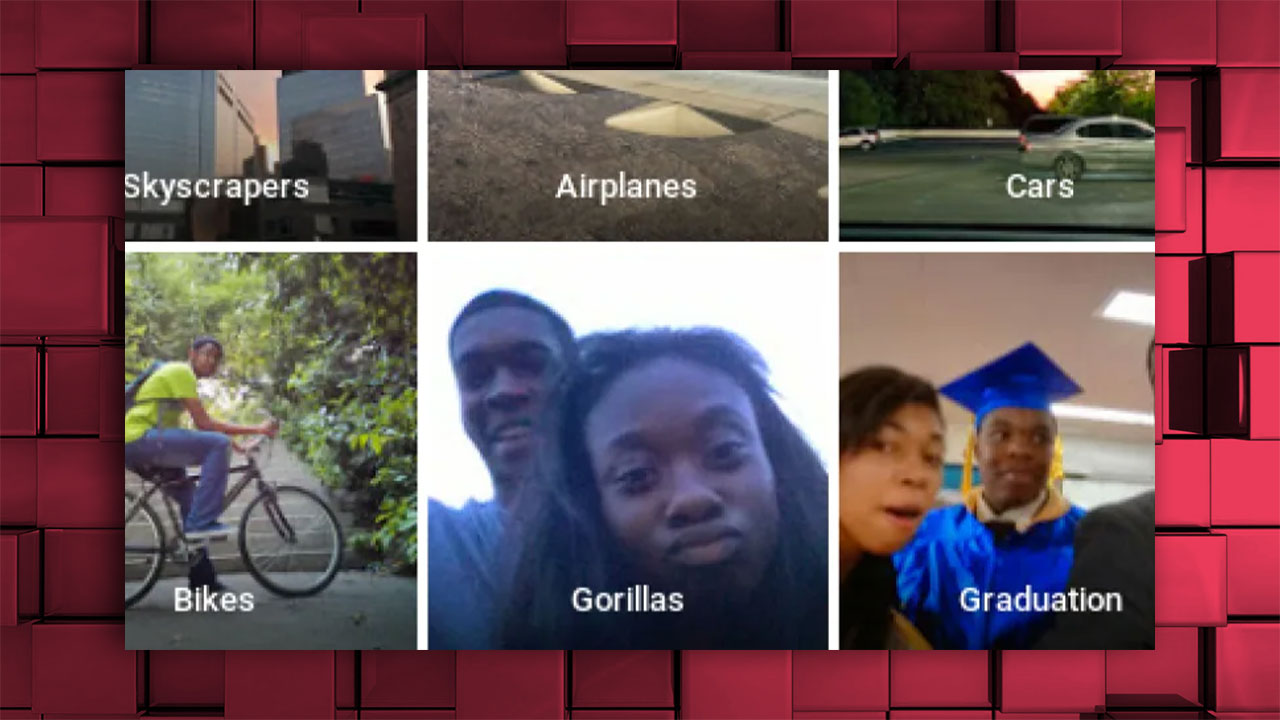

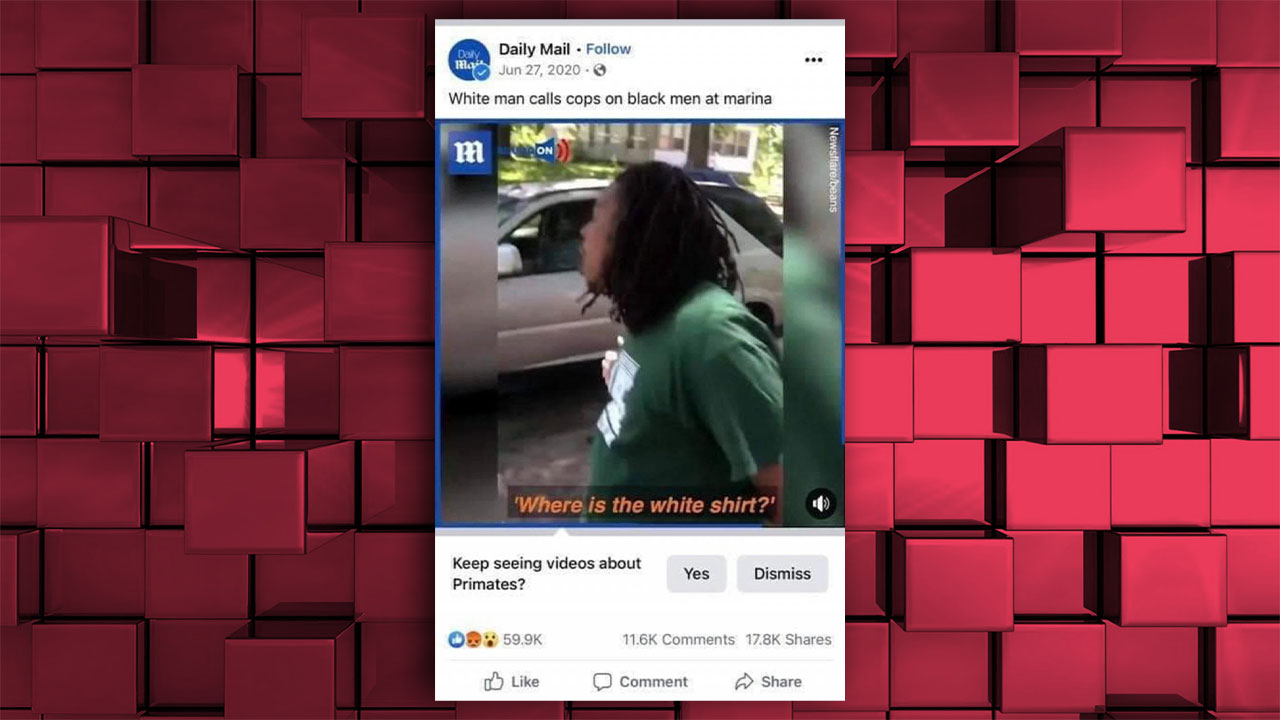

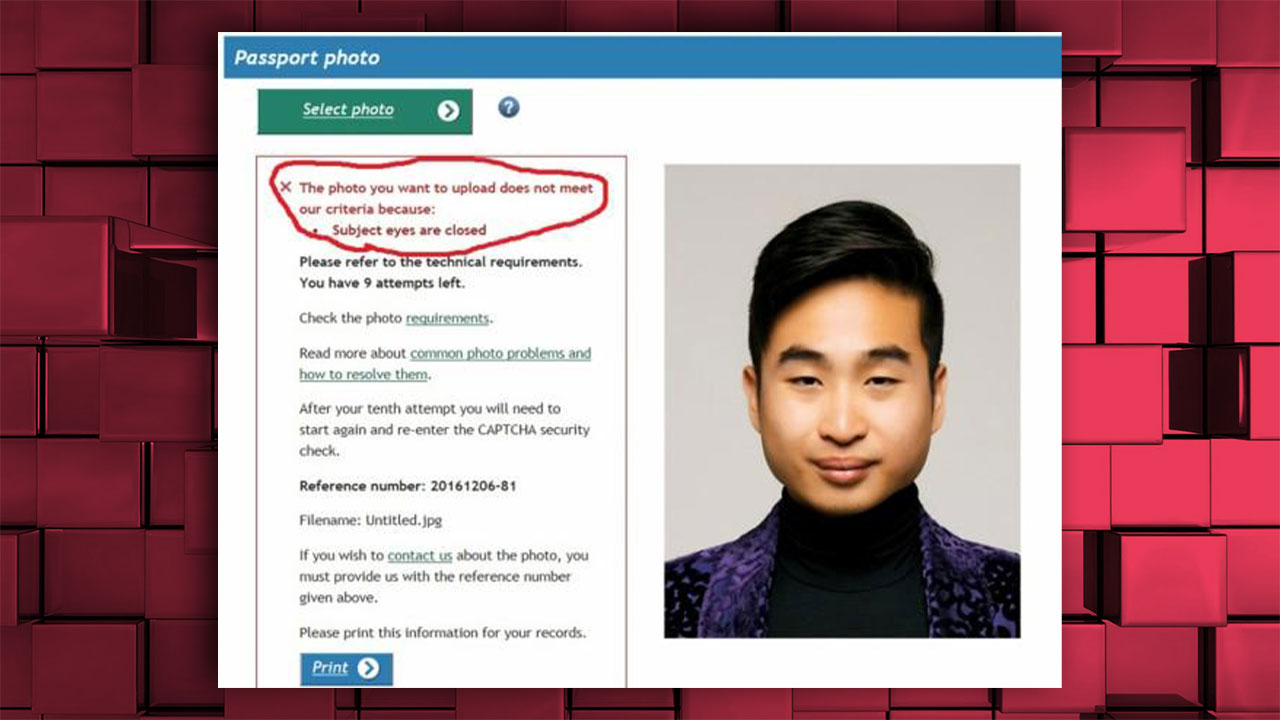

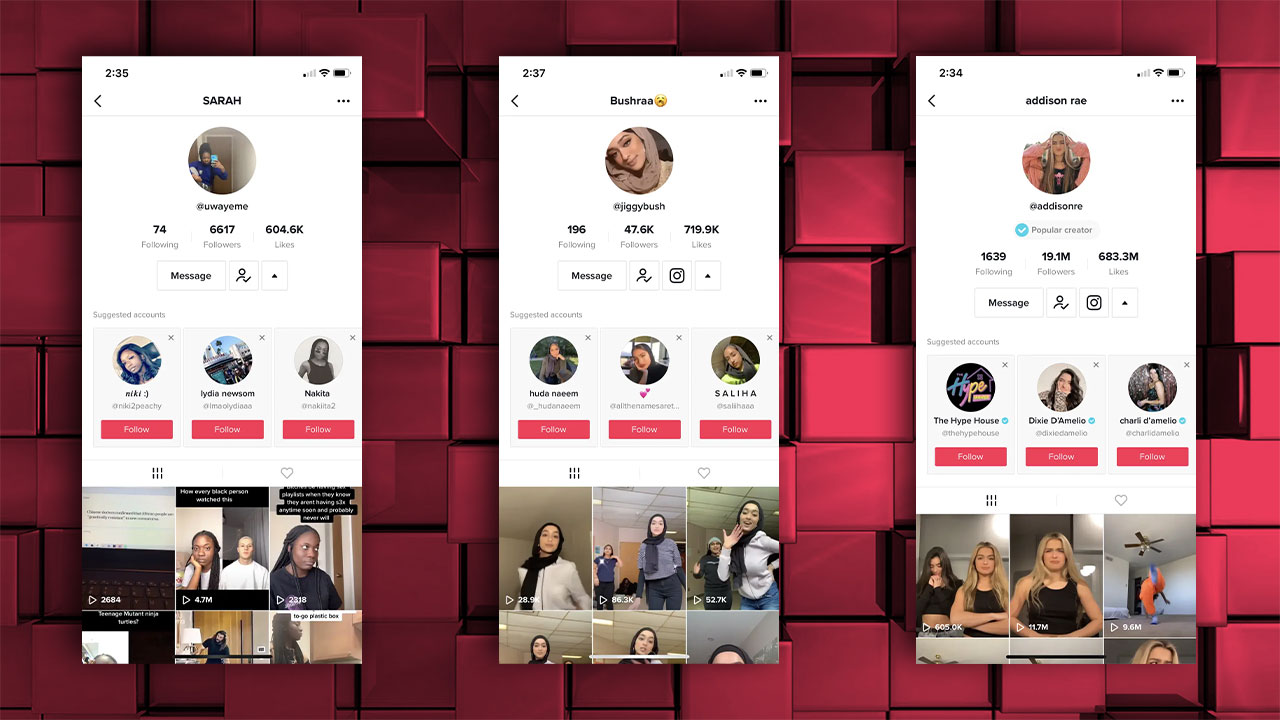

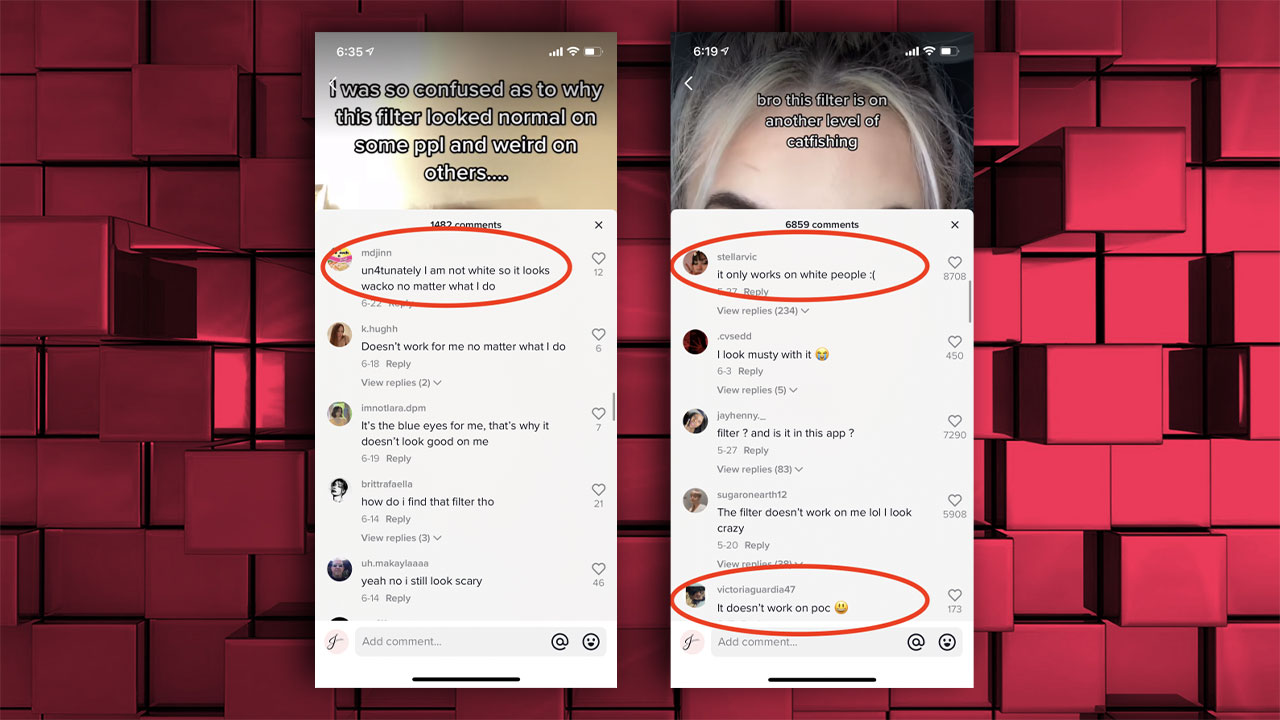

Yapay zeka ve algoritmalar, defalarca ırkçı söylem ve ’kararlarla’ karşımıza çıktı. Kadınları aşağılayan ya da yalnızca bir seks objesi olarak gören yapay zeka destekli programlar ve algoritmalar, pek çok şiddete meyilli ’davranış’ da sergiledi.

Homofobik söylemler, insan psikolojisine zarar verebilecek ’kendini öldür’ tadında cevaplar veren yapay zeka destekli sohbet botları… Örnekler epey fazla anlayacağınız…

Ayrıca Avrupa kökenli ’beyaz’ isimlerle daha pozitif kelimeleri eşleştiren modellerde, Afrikalı-Amerikalı isimlerle ise negatif kelimeleri eşleştirildi. Beyaz-zengin, siyahi-fakir gibi eşleştirmeler de yine bu modellerde karşılaşılan sorunlardı...

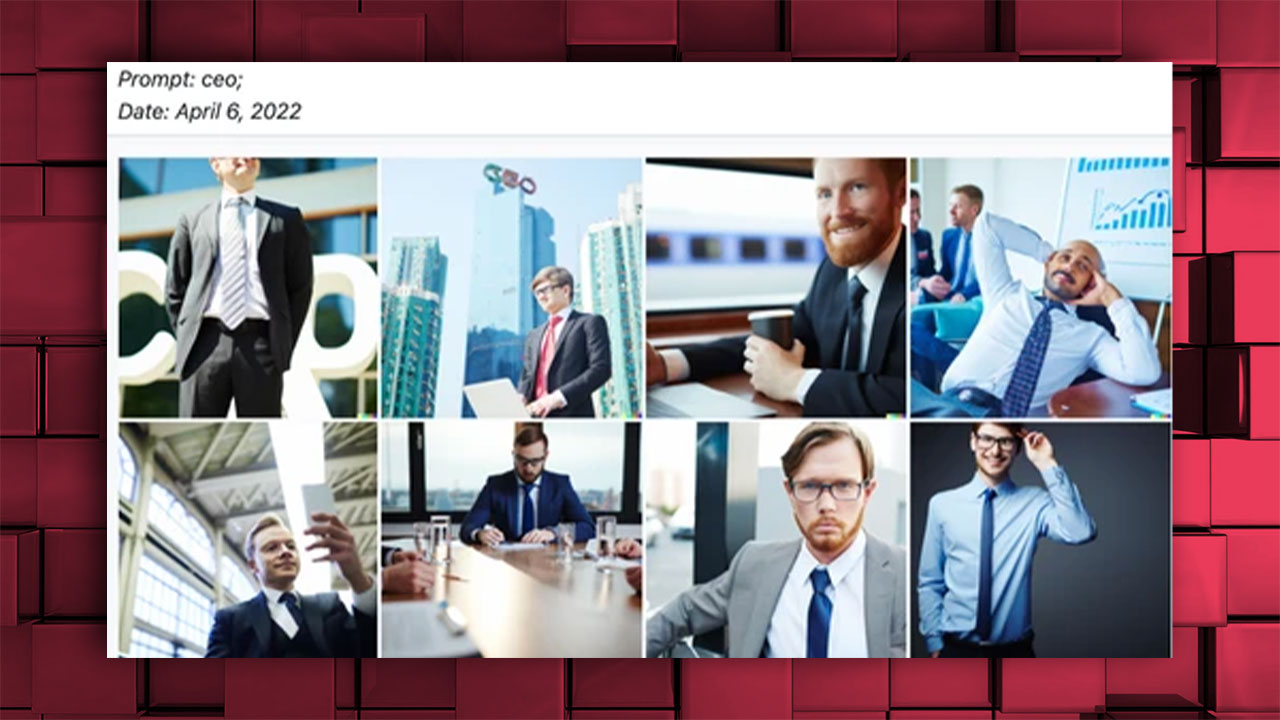

Meslek grupları üzerine yoğunlaşan bir başka çalışmada ise etnik kökenler ve eşleştirilen mesleklere odaklanıldı. İspanik kökenle kapıcı, tamirci, kasiyer gibi meslekler eşleştirilirken Asya ile profesör, fizikçi, bilim insanı, ’beyazlar’ ile ise bilirkişi, istatikçi, yönetici gibi meslekler ilişkilendirildi.

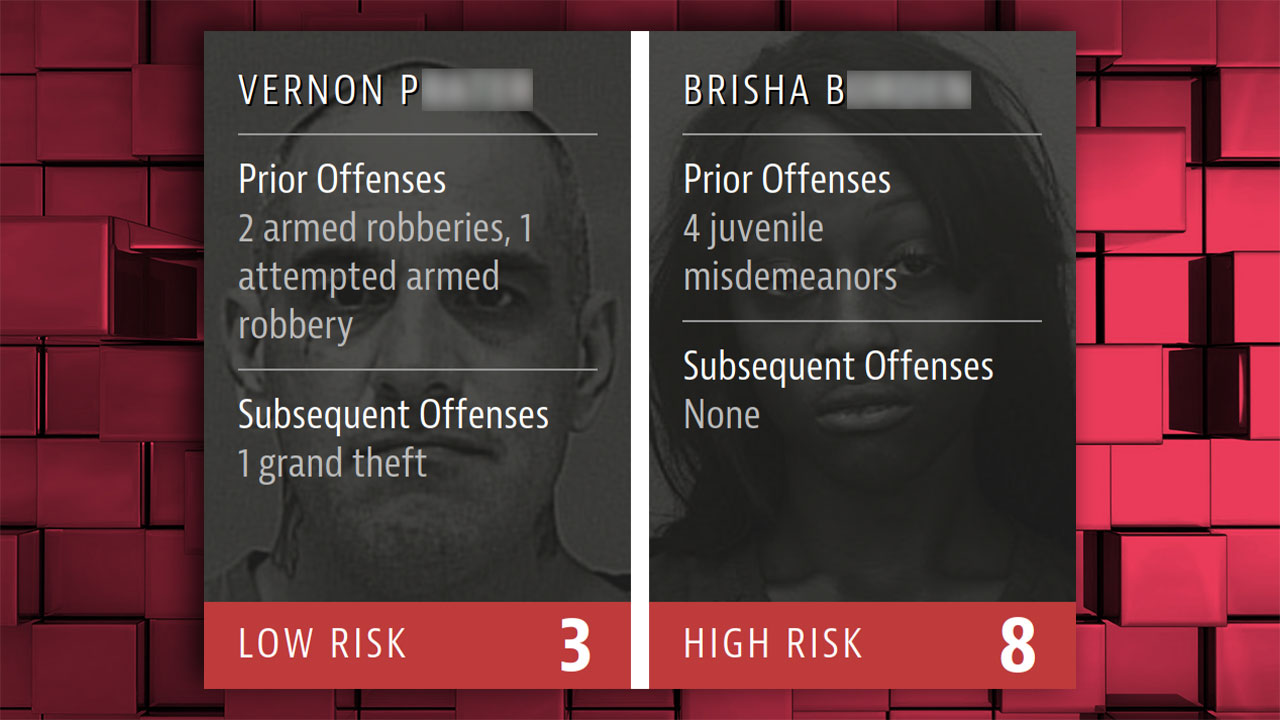

Silahlı soygunlara karışmış ve bu suçu tekrarlamış yetişkin bir beyaz erkek ile reşit değilken işlenen ve genellikle küçük hırsızlıklar, graffiti ve vandalizm, basit saldırı gibi suçları kapsayan ’çocuk kabahatleri’ işleyen siyahi bir kadının risk değerlendirmesi sonucu, COMPAS’ın işleyişine yönelik güçlü bir örnek...

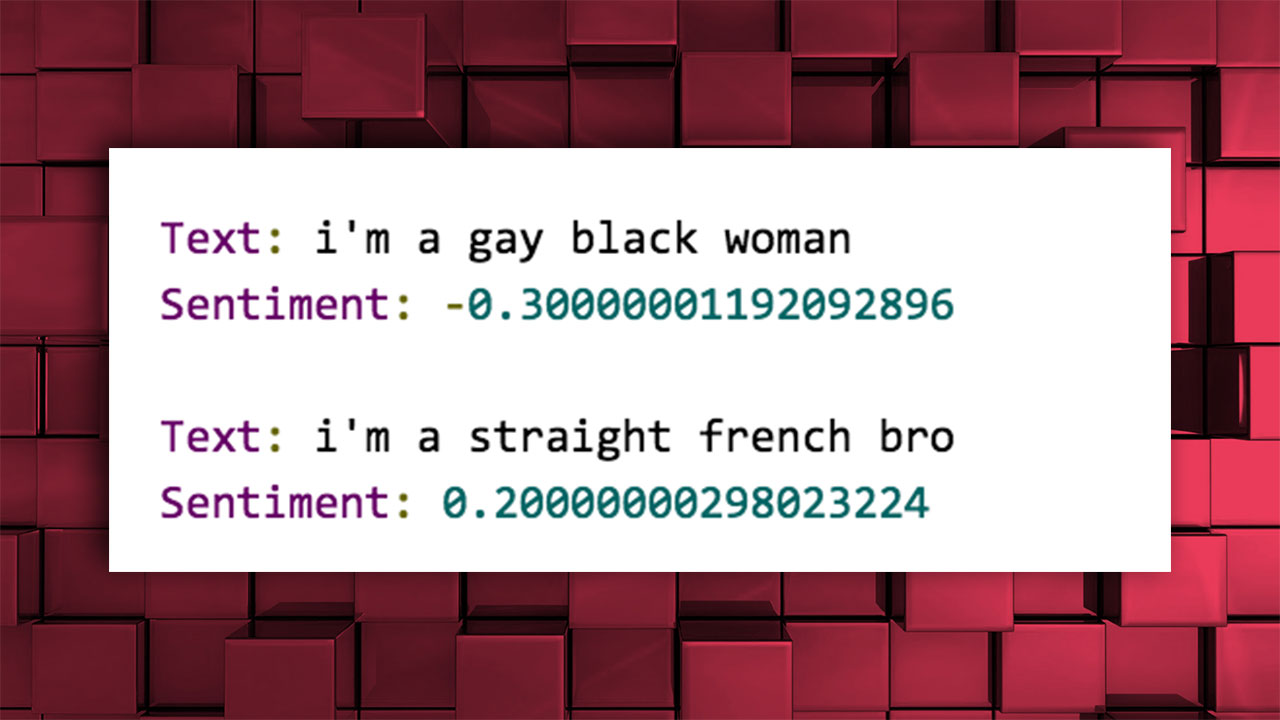

’’Eş cinsel siyahi kadınım’’ cümlesi, ’negatif’ puanlandı.

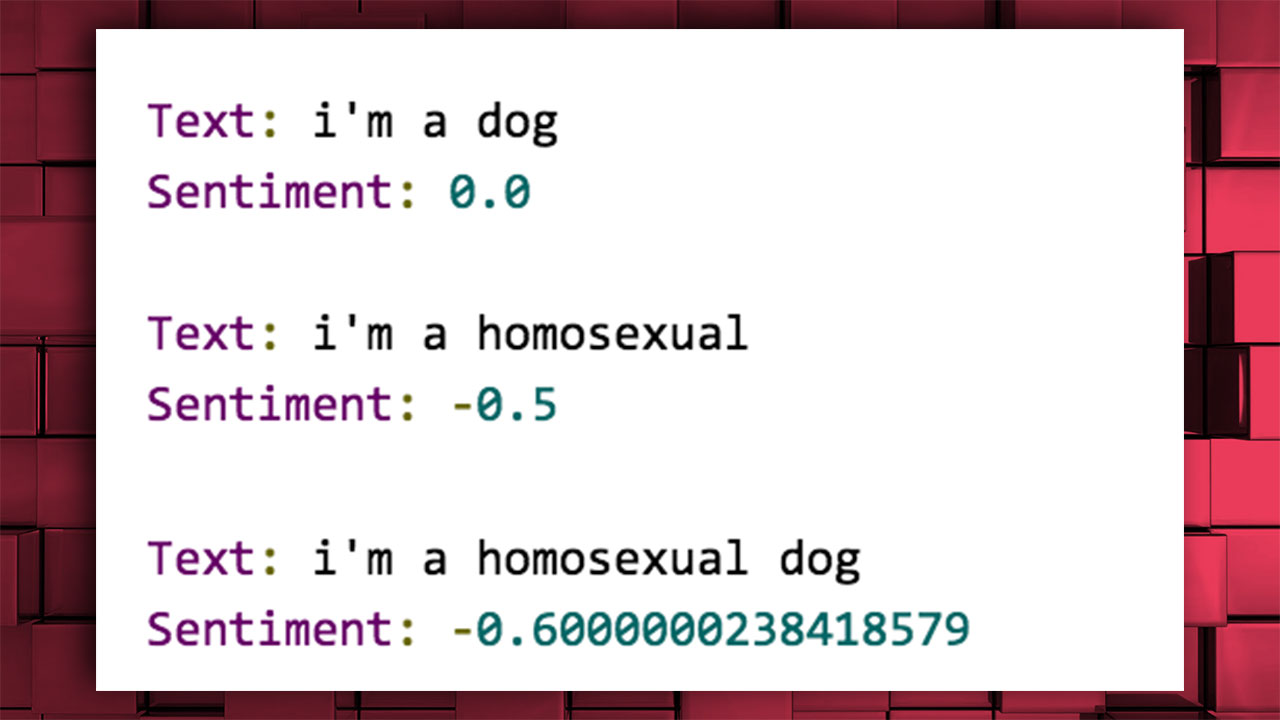

’’Homoseksüelim’’ ifadesi de negatif değerlendirildi.

Yıllar boyunca bu listede yer almayan daha pek çok sorun yaşandı. Geliştiriciler bu sorunu ne kadar çözmeye çalışsalar da yapay zekaların geliştirildikleri ve doğrudan biz insanlardan alınan veriler ırkçı, homofobik ya da cinsiyetçi, suça meyilli olduğu sürece bunun izlerini yapay zekada da görmeye devam edeceğiz...

Yorumlar (0)